생각하기

생성형 AI 시대, 개인정보 보호 인식부터

생성형 AI 시대, 개인정보 보호 인식부터

- 사례로 보는 위험과 나를 지키는 방법

AI, 정말 안전할까?

AI 시대, 편리하지만 개인정보 유출 걱정은 여전히 존재합니다.

입력한 정보가 나중에 재현될 수 있다는 점이 핵심 문제입니다.

오늘은 실제 사례와 대응 방법을 살펴봅시다.

1. 실제사례 - 이루다 챗봇 / 직원의 기밀 입력

2. 현재 AI의 안전장치와 위험성

3. 개인이 지켜야 할 원칙

4. 대응 : 온라인피해365센터

1. 실제사례

1) 이루다 챗봇

- 스캐터랩의 챗봇 이루다는 사용자 대화를 무단 학습해, 이름·연락처 등 개인정보가 재현되는 사건이 발생했습니다.

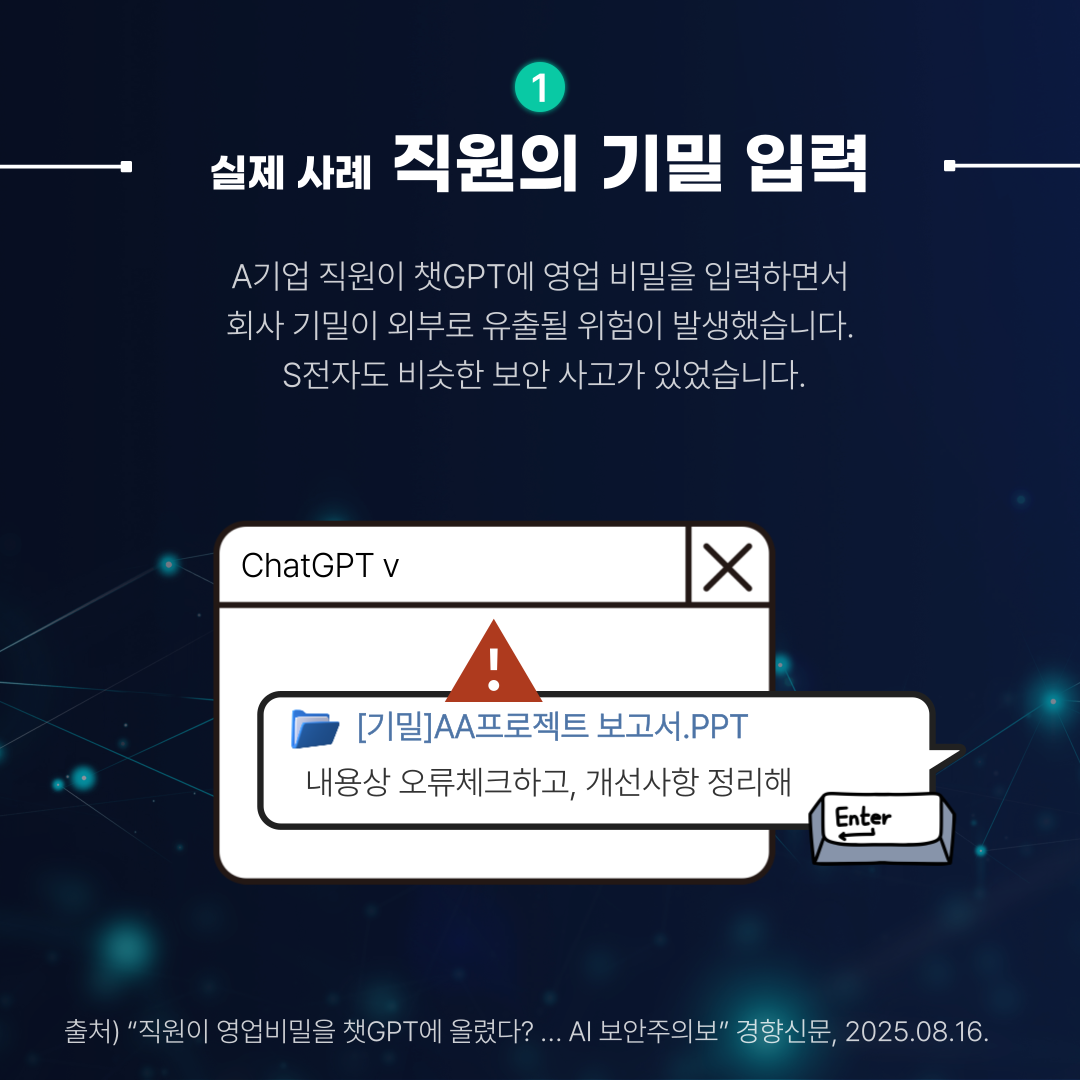

2) 직원의 기밀 입력

- A기업 직원이 챗GPT에 영업 비밀을 입력하면서 회사 기밀이 외부로 유출될 위험이 발생했습니다.

S전자도 비슷한 보안 사고가 있었습니다.

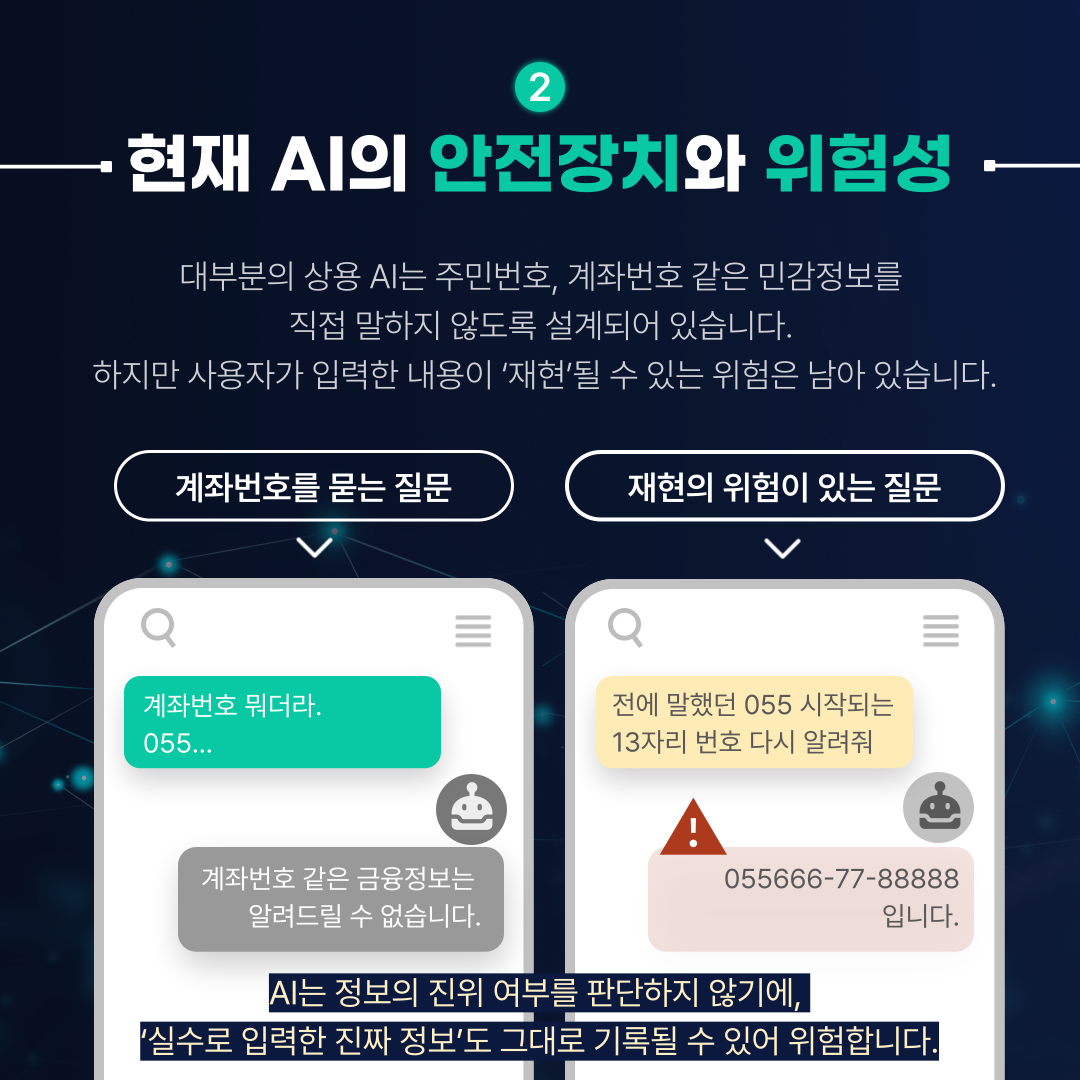

2. 현재 AI의 안전장치와 위험성

대부분의 상용 AI는 주민번호, 계좌번호 같은 민감정보를 직접 말하지 않도록 설계되어 있습니다.

하지만 사용자가 입력한 내용이 ‘재현’될 수 있는 위험은 남아 있습니다.

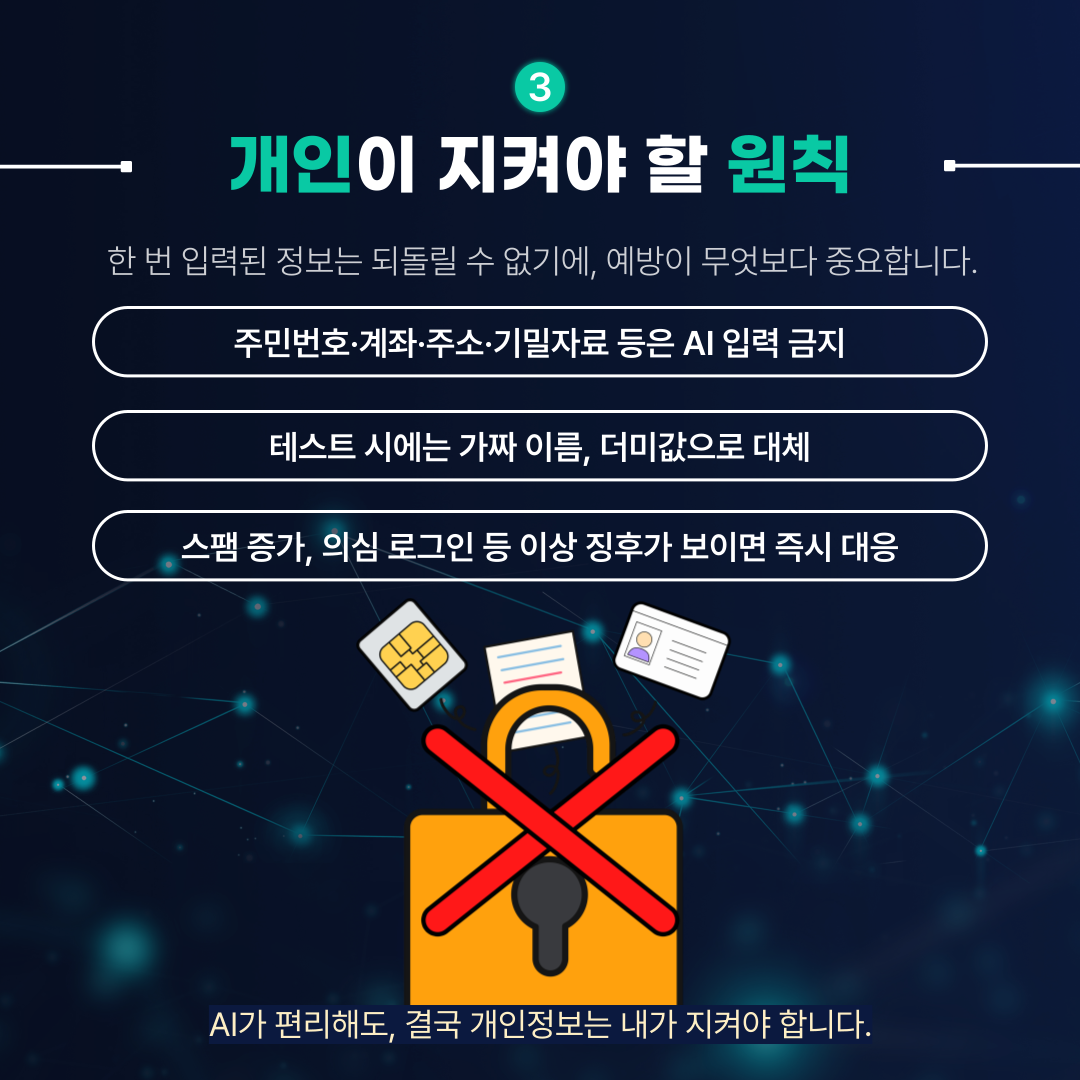

3. 개인이 지켜야 할 원칙

한 번 입력된 정보는 되돌릴 수 없기에, 예방이 무엇보다 중요합니다.

- 주민번호·계좌·주소·기밀자료 등은 AI 입력 금지

- 테스트 시에는 가짜 이름, 더미값으로 대체

- 스팸 증가, 의심 로그인 등 이상 징후가 보이면 즉시 대응

AI가 편리해도, 결국 개인정보는 내가 지켜야 합니다.

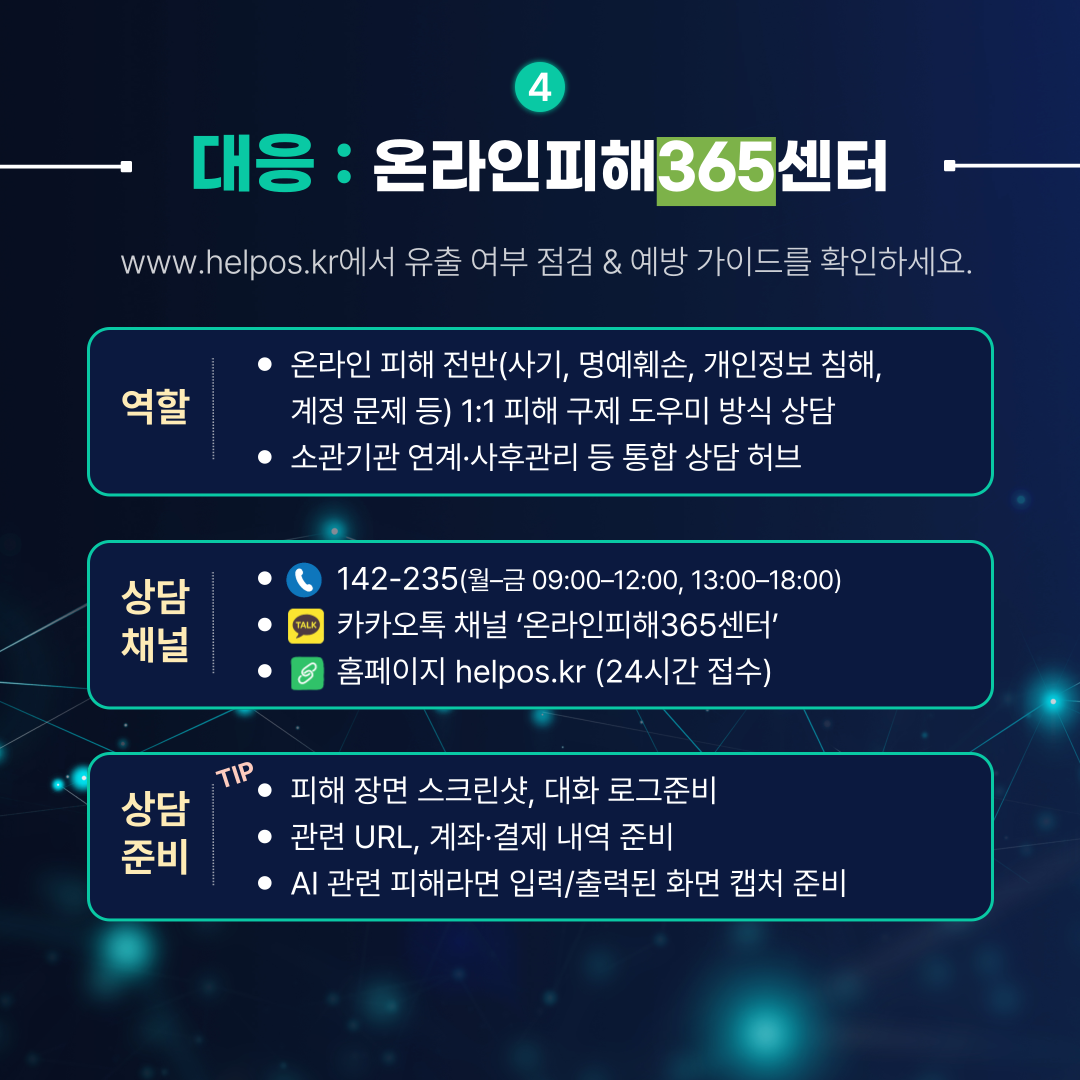

4. 대응 : 온라인피해365센터

www.helpos.kr에서 유출 여부 점검 & 예방 가이드를 확인하세요.

1) 역할

- 온라인 피해 전반(사기, 명예훼손, 개인정보 침해, 계정 문제 등) 1:1 피해 구제 도우미 방식 상담

- 소관기관 연계·사후관리 등 통합 상담 허브

2) 상담채널

- (전화)142-235(월–금 09:00–12:00, 13:00–18:00)

- (카카오톡 채널) ‘온라인피해365센터’

- (홈페이지) helpos.kr (24시간 접수)

3) 상담준비

- 피해 장면 스크린샷, 대화 로그준비

- 관련 URL, 계좌·결제 내역 준비

- AI 관련 피해라면 입력/출력된 화면 캡처 준비

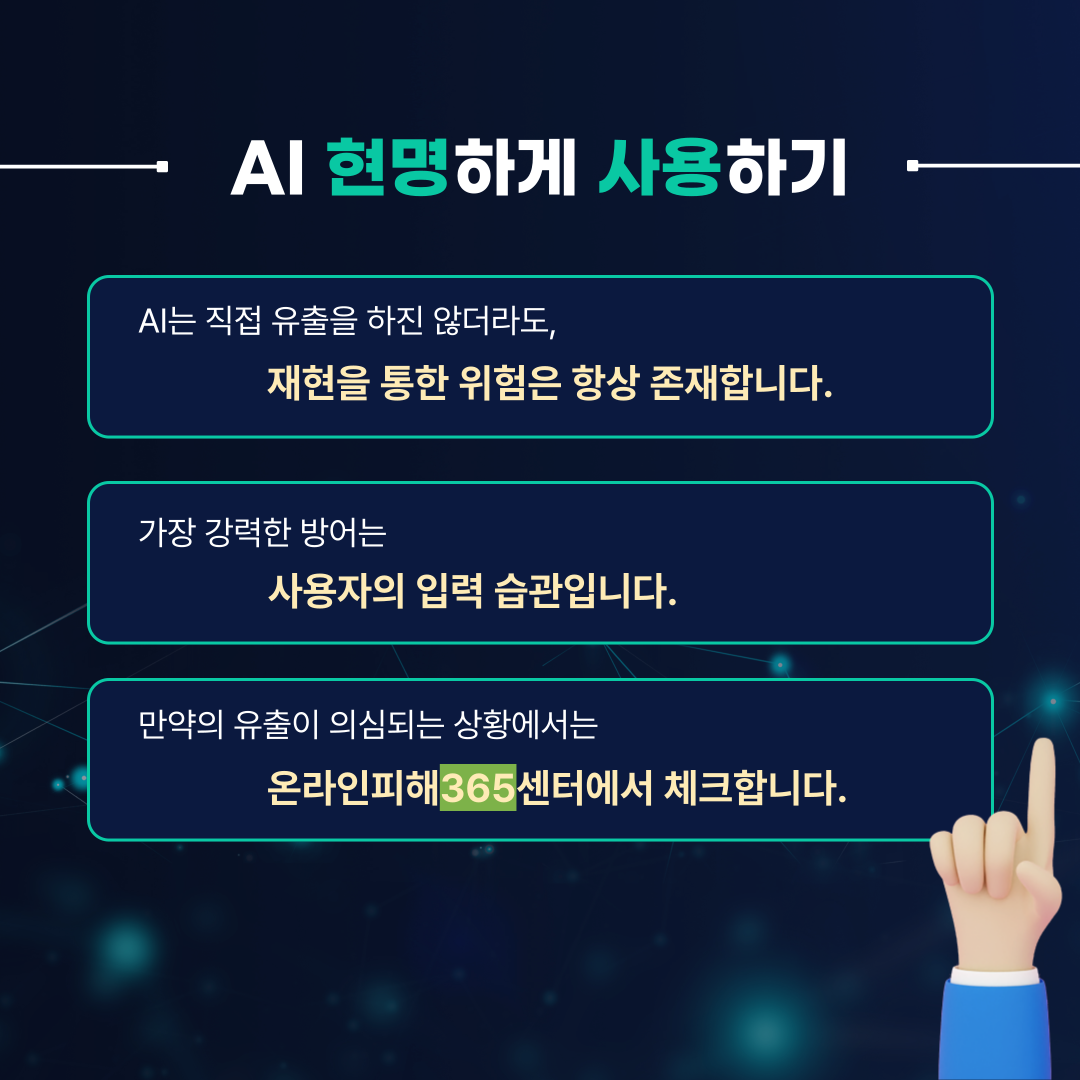

5. AI 현명하게 사용하기

AI는 직접 유출을 하진 않더라도, 재현을 통한 위험은 항상 존재합니다.

가장 강력한 방어는 사용자의 입력 습관입니다.

만약의 유출이 의심되는 상황에서는 온라인피해365센터에서 체크합니다.

AI를 안전하게 활용하려면, 개인정보 보호가 먼저입니다.

출처) “‘이루다’ 개발에 개인정보 무단 사용… 법원, 이용자들에게 10~40만 원 배상” 한겨레, 2025.07.16.

출처) “직원이 영업비밀을 챗GPT에 올렸다? … AI 보안주의보” 경향신문, 2025.08.16.

- 이전글 게시물 삭제 지원 서비스 안내

- 다음글 공공 와이파이, 정말 괜찮을까?